谷歌于近期发布的智能体通信协议Agent2Agent(A2A)引发了业界广泛关注。该协议针对当前AI生态较为封闭,各厂商推出的模型难以互通的问题,建立并开放了一系列智能体间互相通信的机制和规范,允许多个智能体相互配合从而完成复杂的任务,对当前较为破碎的AI生态进行了一定程度的整合。本文聚焦该协议的核心机制和技术框架及其设计理念,分析了该协议为当前AI产业界可能带来的影响,进一步研究了该协议与之前同样用于智能体通信的模型上下文协议(MCP)之间的关系,同时也深入探讨了当前困扰智能体应用取得更广泛落地的原因,最后对中国移动在即将来临的智能体时代中所应扮演的角色进行了一定的思考。

A2A协议诞生的背景

自OpenAI发布ChatGPT大语言模型以来,国内外厂商都在大模型领域投入了大量研发力量,目前市面上的大模型产品也如雨后春笋一般爆发性增长,较有代表性的如国外的ChatGPT系列、Gemini模型,国内的DeepSeek、千问系列模型等纷纷问世并靠着其各自的优势吸引了众多用户,同时还有更多行业大模型也在业内受到了广泛认可。

随着大模型技术的迭代,尤其在思维链技术被普遍采用后,大模型不仅一定程度上避免了输出不可控的问题,也具备了将任务分解执行的功能。使大模型有了作为AI智能代理的能力,从而替代人执行复杂任务,将人类从繁杂的工具操作中解放出来,因此AI智能体(AI Agent)正在成为各大AI厂商角力的方向,据IDC预测,智能体未来将是大模型落地业务场景的主流形式。

智能体需要具备理解用户需求与上下文内容、规划工作流程、连接外部工具和数据以及执行任务并实现的功能,与LLM聊天机器人相比,智能体开发面临着更大的工程挑战。首先是现阶段大模型距离通用人工智能还有很大差距,难以独立处理问题,另一方面互联网“小院高墙”的生态使得一家公司很难独立为用户提供完整业务流。例如要完成一个基本的差旅场景任务,需要气象、出行、生活、铁路、航空等多种应用共同配合才能完成。面对这样的现状,由多智能体协同合作完成任务成为了当前阶段的最优解,但是各智能体的接入和信息传输方式均有区别。在使来自不同厂商、基于不同框架、由不同公司在独立服务器上构建的彼此不兼容的智能体协同起来的同时,还要降低开发量,避免对接中出现的大量定制API和“胶水代码”,这就迫切需要业界有影响力的公司牵头推出相关标准。在此背景下,谷歌Agent2Agent(A2A)协议应运而生,志在打造智能体时代的TCP协议。

A2A协议的架构和核心特性

A2A协议是谷歌于2025年4月11日提出的一项开放标准,旨在实现多智能体间无缝通信和互操作,培育一个更互联、更强大和更具创新性的AI生态,创建一种智能体间的“通用语言”。A2A协议通过分解任务至不同智能体的方式,一定程度上将当前智能体领域研发的重点从构建更智能、更全面的模型转移到了设计可以实时、高效协同工作的智能体网络上来。

A2A协议立足较为通用的HTTP、SSE、JSON-RPC 2.0等数据交换方式,遵循Client-Server模式,其中客户端智能体(Client Agent)负责接收用户需求,发现并找到合适的服务端智能体(Remote Agent)发送任务请求,将服务端智能体反馈的信息进行整合后发送给用户。而服务端智能体负责处理用户需求,向客户端反馈信息。了解A2A协议关键是要了解以下几个核心概念和机制:

(一)A2A协议的核心概念

智能体标签(Agent Card):智能体互相发现的核心组件,一般是作为公共清单托管在公共服务器上的JSON文件。标签描述了智能体的名称、功能、URL、版本、输入输出格式、使用样例和身份验证要求等信息,充当智能体的“身份证”或“简历”。

任务(Task):任务是智能体协作的核心概念,由客户端通过用户请求创建,以使服务端智能体执行工作。每个任务都有唯一ID并须经历一个完整的生命周期。任务会有提交、工作中、需要输入、完成、失败或取消等多个状态。同时,A2A协议不仅支持同步请求,还支持流式请求与异步请求,支持长周期异步通信,所以一个任务的生命周期可能会长达几天。

单元(Part):是组成消息或工件(Artifact)的基本内容单元。它的构成既可以是文本、文件,也有可能是JSON格式或表格形式的数据。

工件(Artifact):表示智能体在任务执行过程中产生的输出(例如生成的文件以及结构化数据等),一个工件内可以包含多个单元。服务端智能体对客户端需求产生的响应均以工件的形式反馈到客户端,再由客户端整理后提供给用户。

(二)A2A协议的核心机制

能力发现(Capability Discovery):客户端智能体使用智能体标签来发现其他智能体,获取该智能体的信息以支持自身可以安全有效地与其交互。该过程类似于微服务架构中的服务发现机制,由智能体标签进行功能声明,允许其他智能体无需事先了解其实现细节便可以发现和使用其服务。

任务管理(Task Management):该机制用于任务的提交和跟踪,内置了对复杂工作流的生命周期管理以及对分布式任务执行的支持。

协作(Collaboration):智能体间通过相互通信进行合作解决问题,协议支持同步、异步通信以供传达模型上下文内容、服务端回复工件以及用户指令等。

用户体验协商(User Experience Negotiation):由服务端发送一条完整的内容例如生成的图像、视频,包含若干个单元,每个单元都有特定的内容类型,例如iframe、视频、文字内容等,由客户端和服务端协商所需的正确格式,选择对用户体验最好的一种传输方式。

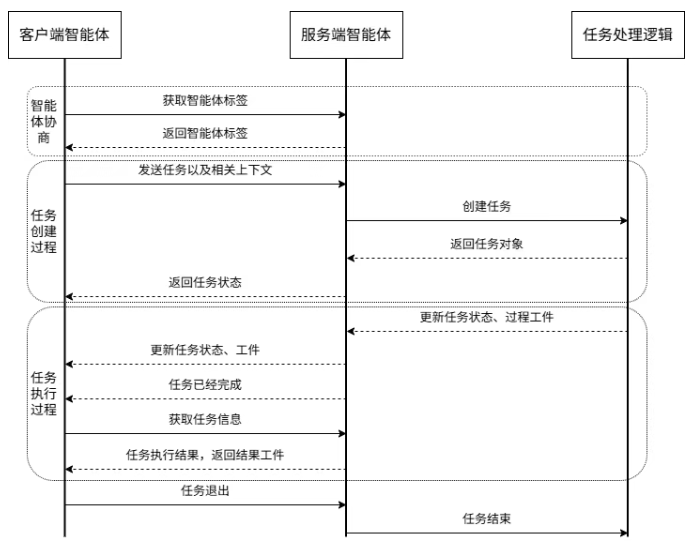

总结一下A2A协议框架下智能体协商、工作流程如图1,先由客户端智能体发现服务端智能体并创建任务,再由双方不断协商任务进程,此时服务端智能体可以实时反馈信息、要求用户补充上下文内容以及进行用户体验协商等,最后服务端完成任务向客户端反馈结果工件。

图1 A2A协议框架下智能体协商流程

A2A协议与MCP协议的关系

MCP协议,全称 Model Context Protocol,即模型上下文协议,是由美国人工智能厂商Anthropic 公司于2024年12月提出并开源的一项开放协议。随着OpenAI于3月宣布接入MCP协议,该协议由此备受瞩目,迈上了发展的快车道。MCP协议与A2A协议同样是作为智能体的通信协议,都受到了业内广泛关注和支持,二者的关系也很微妙。

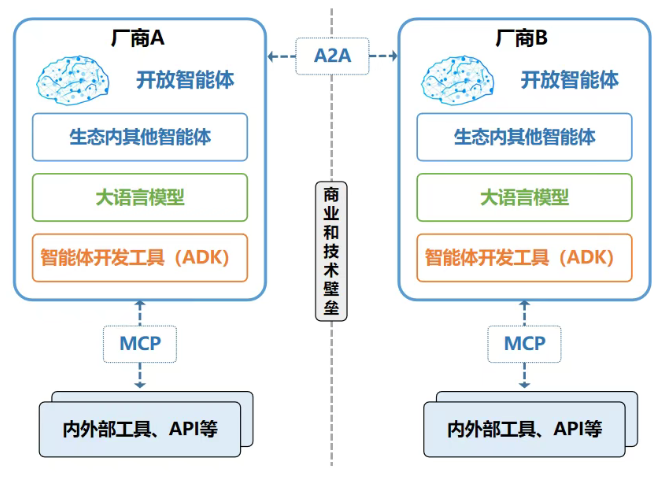

首先,二者存在显著的区别。谷歌在推出A2A协议伊始就不断对外宣称A2A与MCP绝非竞争关系,而是合作关系。A2A协议侧重于智能体间通信,而MCP则侧重于智能体与工具间的通信。未来可能的业务流程如图2所示,由一个面向客户的助理型智能体来倾听用户需求,并找到需要调用的智能体,通过A2A协议调用该智能体,这些被调用到的智能体再通过MCP协议来访问该智能体所掌握的内外部工具完成任务。这样看来,MCP协议不仅不会与A2A协议构成竞争关系,反而还会大大增强A2A协议的服务能力,但事情可能并不是这么简单。

如果深入分析MCP与A2A我们会发现,二者在更宏观的角度上是存在一定竞争关系的,甚至代表了智能体的两种发展路线。在A2A协议出现之前,将智能体视作一般应用,使用MCP调用指定功能或特定提示词同样可以实现智能体通信,但该方案难以实现长周期的异步通信,A2A协议首先会抢占这部分市场。

更重要的是,MCP协议体现的是一种以我为中心,以大模型为核心的智能体发展路线。在MCP协议的畅想下,智能体可以通过MCP调用第三方服务,而第三方服务只需要将自身功能、数据对接MCP协议,使智能体获取相关服务的反馈便可完成任务。这种工作模式会存在两点问题:第一,大模型是否已经到了可以独立执行任务的阶段?显然,在当前阶段,很多任务尤其是在涉及跨模态任务时,依然需要专用模型配合完成,难以使用单一大模型独立完成。第二,如果智能体需要调用第三方工具,而第三方服务提供商会甘于对接MCP协议做一个“工具”吗?如果大模型可以直接获取第三方服务反馈的内容,就相当于第三方将产品逻辑交给了智能体厂商,这显然会造成内容平台和服务用户流失,原有应用可能会萎缩为大模型的API,相关的厂商恐怕很难接受这种方案。而A2A协议考虑到了这点,允许厂商使用智能体包装自身应用并对外暴露,保证了应用的不透明性,控制了访问范围,从而避免陷入上述尴尬局面。

总之,MCP协议偏重于通过一个全面的智能体来利用他掌握的各种工具解决问题,更接近于建设通用人工智能的发展思路。而A2A协议则一定程度上回避了构建更强人工智能的挑战,把所有智能体看作平等独立的地位,并对他们进行分工,由特定的智能体负责特定生态执行特定任务,他们通过互相对话协作解决问题,是对当前碎片化的AI生态乃至互联网生态的一种整合,更适合现今的互联网生态和大模型的发展水平。

在可预见的未来,MCP协议可能会成为底层的模型调用工具协议,在己方生态下调用工具完成相对单一的任务,如图2。更广阔的应用之间的协议可能会被A2A这种智能体通信协议牢牢占据。

图2 未来智能体间协同工作架构

智能体发展面临的挑战

尽管智能体已经取得了长足的发展,但实际落地应用还是多集中于软件开发、市场营销、IT运营和文本摘要等对准确率要求不高的企业场景,其中软件开发是最主要的场景。智能体应用存在落地难、应用难的问题。分析当前限制智能体取得更广泛应用的原因主要有以下三点:

一是不符合当前用户使用习惯。尽管使用智能体来代替个人完成订酒店、订机票等繁琐的操作看起来很有吸引力,但当前用户依然还是更希望AI仅提供参考意见而非直接完成操作。尤其是在很多涉及到个人隐私和财产安全的场景里,用户还是更喜欢亲力亲为。

二是智能体很难精确理解用户需求。在日常生活的绝大多数场景里,用户很难一开始就有一个精确的、可以指导大模型完成决策的需求,而是在自己不断搜集信息的过程中将需求逐渐完善,在这个过程中,AI可能还是更多扮演一个信息提供者的角色而非执行者。另一方面,由于当前大模型非常依赖用户的提示词,而用户很难完成一个足够准确的可以完全描述自己需求的提示词,这也是智能体面临的一个挑战。

三是智能体完成任务成功率依然有待提升。当前的大模型虽然在很多单一任务上都有令人惊叹的表现,但是在处理复杂任务时依然很难做到100%的成功率,尤其是在替代人工操作的任务中,无法做到100%成功率往往就意味着不能完全取代人工,甚至有可能会带来额外的工作量。并且,当前大模型依然存在幻觉问题,在多智能体协同完成任务场景下该问题尤为严重,模型产生的幻觉会逐级传导,甚至导致严重的事故,这对智能体的应用限制极大。

总结与展望

毫无疑问,随着AI的发展,智能体是AI应用的未来,而在智能体取得广泛应用的时代,以A2A协议为代表的智能体通信协议一定会以通信基础协议的方式带动产业发展,一如TCP协议之于互联网。但是,我们也应该看到,协议层面能解决的只是智能体间的通信问题,而智能体背后大模型的能力水平才是决定智能体应用的关键。

【参考文献】

[1]AIGC应用层十大趋势白皮书. IDC, 2024.

[2] Prompting for action How AI agents are reshaping the future of work. 德勤AI研究院, 2024.

[3] State of AI Agents.LangChain, 2024.