通信世界网消息(CWW)8月14日,据智元机器人消息,智元机器人推出面向真实世界机器人操控的统一世界模型平台Genie Envisioner(GE)。 不同于传统“数据-训练-评估”割裂的流水线模式,GE将未来帧预测、策略学习与仿真评估首次整合进以视频生成为核心的闭环架构,使机器人在同一世界模型中完成从“看”到“想”再到“动”的端到端推理与执行。

据了解,GE的核心突破在于构建了基于世界模型的以视觉中心的建模范式。不同于主流VLA(Vision-Language-Action)方法依赖视觉-语言模型将视觉输入映射到语言空间进行间接建模,GE直接在视觉空间中建模机器人与环境的交互动态。这种方法完整保留了操控过程中的空间结构和时序演化信息,实现了对机器人-环境动态更精确、更直接的建模。

这一视觉中心的建模范式带来了两个关键优势。

高效的跨本体泛化能力

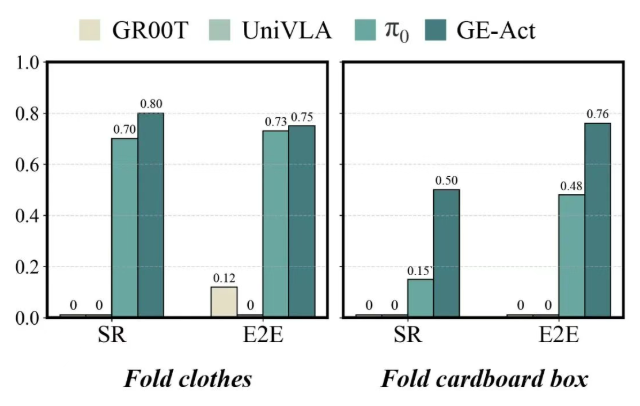

基于强大的视觉空间预训练,GE-Act仅需极少量数据即可实现跨平台迁移。在Agilex Cobot Magic和Dual Franka等全新机器人平台上,GE-Act仅使用1小时(约250个演示)的遥操作数据就实现了高质量的任务执行。相比之下,即使是在多本体数据上有大规模预训练的π0和GR00T模型,在相同数据量下的表现也不如GE-Act。

这种高效泛化源于GE-Base在视觉空间中学习到的通用操控表征。通过直接建模视觉动态而非依赖语言抽象,模型能够捕捉到跨平台共享的底层物理规律和操控模式,从而实现快速适配。

长时序任务的精确执行能力

更重要的是,视觉中心建模赋予了GE强大的未来时空预测能力。通过在视觉空间中显式建模时序演化,GE-Act能够规划和执行需要长时序推理的复杂任务。

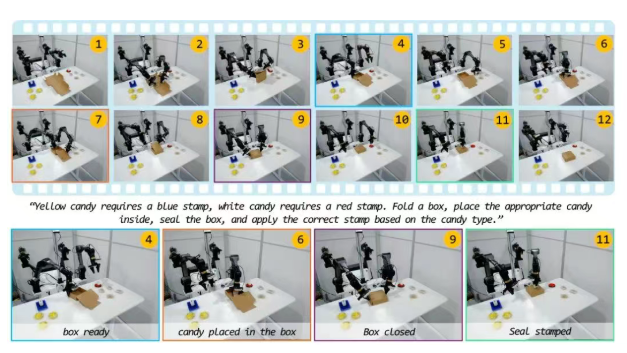

在折叠纸盒等超长步骤任务中,GE-Act展现出了远超现有SOTA方法的性能。以纸盒折叠为例,这项任务需要精确执行超过10个连续子步骤,每个步骤都依赖于前序动作的准确完成。GE-Act达到了76%的成功率,而专门针对柔性物体操控优化的π0仅为48%,UniVLA和GR00T则完全无法完成(0%成功率)。

这种长时序执行能力的提升不仅源于GE的视觉世界建模,同时也得益于我们创新设计的sparse memory模块。通过这样的模块设计,能够帮助机器人选择性地保留关键历史信息,从而在长时序任务中保持精确的上下文理解。通过预测未来的视觉状态,GE-Act能够"预见"动作的长期后果,从而生成更连贯、更稳定的操控序列。相比之下,基于语言空间的方法在长时序任务中容易出现误差累积和语义漂移。